همچنین می توانید نه برای بهترین نقطه در جهت گرادیان، بلکه برای نقطه ای بهتر از نقطه فعلی جستجو کنید.

ساده ترین روش برای پیاده سازی تمام روش های بهینه سازی محلی. کاملا دارد شرایط ضعیفهمگرایی، اما میزان همگرایی بسیار کم (خطی) است. مرحله روش گرادیان اغلب به عنوان بخشی از روش های بهینه سازی دیگر، مانند روش فلچر-ریوز استفاده می شود.

توضیحات [ | ]

بهبودها[ | ]

هنگام حرکت در امتداد دره و با افزایش تعداد متغیرها، روش نزول گرادیان بسیار کند است. تابع هدفاین رفتار روش معمولی می شود. برای مبارزه با این پدیده از آن استفاده می شود که ماهیت آن بسیار ساده است. پس از انجام دو مرحله شیب نزول و به دست آوردن سه نقطه، مرحله سوم باید در جهت بردار اتصال نقطه اول و سوم، در امتداد پایین دره برداشته شود.

برای توابع نزدیک به درجه دوم، روش گرادیان مزدوج موثر است.

کاربرد در شبکه های عصبی مصنوعی[ | ]

روش نزول گرادیان، با مقداری اصلاح، به طور گسترده ای برای آموزش پرسپترون استفاده می شود و در تئوری شبکه های عصبی مصنوعی به عنوان روش پس انتشار شناخته می شود. هنگام آموزش یک شبکه عصبی از نوع پرسپترون، لازم است ضرایب وزنی شبکه را طوری تغییر دهید که به حداقل برسد. خطای متوسطدر خروجی شبکه عصبی زمانی که دنباله ای از داده های ورودی آموزشی به ورودی ارائه می شود. به طور رسمی، برای برداشتن تنها یک مرحله با استفاده از روش نزول گرادیان (فقط یک تغییر در پارامترهای شبکه)، لازم است که به طور متوالی تمام مجموعه داده های آموزشی به ورودی شبکه ارسال شود، خطا برای هر شیء محاسبه شود. داده های آموزشی را محاسبه کرده و تصحیح لازم ضرایب شبکه را محاسبه کرده (اما این اصلاح را انجام ندهید) و پس از ارسال کلیه داده ها، مقدار در تنظیم هر ضریب شبکه (مجموع شیب ها) را محاسبه کرده و ضرایب را "یک مرحله ای" تصحیح کنید. . بدیهی است که با مجموعه بزرگی از داده های آموزشی، الگوریتم بسیار کند کار می کند، بنابراین در عمل، ضرایب شبکه اغلب پس از هر عنصر آموزشی تنظیم می شود، جایی که مقدار گرادیان با گرادیان تابع هزینه تقریبی می شود، که تنها بر روی یک آموزش محاسبه می شود. عنصر این روش نامیده می شود نزول گرادیان تصادفی یا نزول شیب عملیاتی . نزول گرادیان تصادفی شکلی از تقریب تصادفی است. تئوری تقریب های تصادفی شرایطی را برای همگرایی روش نزول گرادیان تصادفی فراهم می کند.

پیوندها [ | ]

- جی. ماتیوس.ماژول برای شیب ترین نزول یا روش گرادیان. (لینک در دسترس نیست)

ادبیات [ | ]

- آکولیچ آی. ال.برنامه نویسی ریاضی در مثال ها و مسائل. - م.: دبیرستان، 1986. - ص 298-310.

- گیل اف.، موری دبلیو.، رایت ام.بهینه سازی عملی = بهینه سازی عملی. - م.: میر، 1364.

- کورشونوف یو.مبانی ریاضی سایبرنتیک - M.: Energoatomizdat، 1972.

- ماکسیموف یو.، فیلیپوفسکایا ای.الگوریتم های حل مسائل برنامه ریزی غیرخطی - M.: MEPhI، 1982.

- ماکسیموف یو.الگوریتم های برنامه ریزی خطی و گسسته - M.: MEPhI، 1980.

- کورن جی.، کورن تی.کتاب ریاضیات برای دانشمندان و مهندسان. - M.: Nauka، 1970. - P. 575-576.

- S. Yu. Gorodetsky، V. A. Grishagin.برنامه نویسی غیرخطی و بهینه سازی چند جانبی - نیژنی نووگورود: انتشارات دانشگاه نیژنی نووگورود، 2007. - صص 357-363.

شیب ترین روش فرود یک روش گرادیان با گام متغیر است. در هر تکرار، اندازه گام k از شرط حداقل تابع f(x) در جهت نزول انتخاب میشود، یعنی.

این شرایط به این معنی است که حرکت در امتداد ضد گرادیان تا زمانی رخ می دهد که مقدار تابع f (x) کاهش یابد. از نقطه نظر ریاضی، در هر تکرار لازم است مشکل کمینه سازی یک بعدی توسط تابع حل شود.

()=f (x (k) -f (x (k)))

برای این کار از روش نسبت طلایی استفاده می کنیم.

الگوریتم روش شیب دارترین فرود به شرح زیر است.

مختصات نقطه شروع x (0) مشخص شده است.

در نقطه x (k) ، k = 0، 1، 2، ...، مقدار گرادیان f (x (k)) محاسبه می شود.

اندازه گام k با کمینه سازی یک بعدی با استفاده از تابع تعیین می شود

()=f (x (k) -f (x (k))).

مختصات نقطه x (k) تعیین می شود:

x i (k+1) = x i (k) - k f i (x (k))، i=1، …، n.

شرط توقف فرآیند تکراری بررسی می شود:

||f (x (k +1))|| .

اگر برآورده شود، محاسبات متوقف می شود. در غیر این صورت به مرحله 1 می رویم. تفسیر هندسی روش شیب دارترین فرود در شکل ارائه شده است. 1.

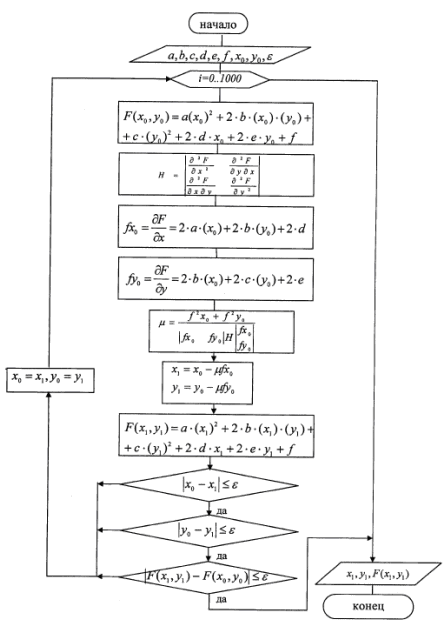

برنج. 2.1. بلوک دیاگرام شیب دارترین روش فرود.

پیاده سازی روش در برنامه:

روش شیب دارترین فرود.

برنج. 2.2. اجرای شیب دارترین روش فرود.

نتیجه گیری: در مورد ما، روش در 7 تکرار همگرا شد. نقطه A7 (0.6641; -1.3313) یک نقطه افراطی است. روش جهات مزدوج. برای توابع درجه دوم، می توانید یک روش گرادیان ایجاد کنید که در آن زمان همگرایی متناهی و برابر با تعداد متغیرهای n باشد.

اجازه دهید یک جهت معین را صدا بزنیم و با توجه به برخی از ماتریس هس قطعی مثبت H مزدوج کنیم اگر:

پس یعنی برای واحد H، جهت مزدوج به معنای عمود آنهاست. در حالت کلی، H غیر پیش پا افتاده است. در مورد کلی conjugacy استفاده از ماتریس هس برای یک بردار است - به معنای چرخش این بردار با زاویه ای، کشش یا فشرده کردن آن است.

و اکنون بردار متعامد است، یعنی مزدوج متعامد بودن بردار نیست، بلکه متعامد بودن بردار چرخانده شده است.

برنج. 2.3. بلوک دیاگرام روش جهت های مزدوج.

پیاده سازی روش در برنامه: روش جهت های مزدوج.

برنج. 2.4. پیاده سازی روش جهت های مزدوج.

برنج. 2.5. نمودار روش جهت های مزدوج.

نتیجه گیری: نقطه A3 (0.6666; 1.3333-) در 3 تکرار یافت شد و یک نقطه اکستریم است.

3. تحلیل روش های تعیین مقدار حداقل و حداکثر یک تابع در صورت وجود محدودیت

بگذارید آن را به خاطر بیاوریم وظیفه مشترکبهینه سازی شرطی به این شکل است

f(x) ® min، x О W،

که در آن W یک زیر مجموعه مناسب از Rm است. یک زیر کلاس از مسائل با محدودیتهای نوع برابری با این واقعیت متمایز میشود که مجموعه با محدودیتهای شکل تعریف میشود.

f i (x) = 0، که در آن f i: R m ®R (i = 1، …، k).

بنابراین،W = (x О R m: f i (x) = 0، i = 1، …، k).

نوشتن شاخص "0" برای تابع f برای ما راحت خواهد بود. بنابراین، مسئله بهینه سازی با محدودیت های نوع برابری به صورت نوشته شده است

f 0 (x) ® دقیقه، (3.1)

f i (x) = 0، i = 1، …، k. (3.2)

اگر اکنون با f تابعی را در Rm با مقادیر R k نشان دهیم که نماد مختصات آن به صورت f(x) = (f 1 (x)، ...، f k (x)) است، سپس ( 3.1)–(3.2) همچنین می توانیم آن را به شکل بنویسیم

f 0 (x) ® min، f(x) = Q.

از نظر هندسی، مسئله با محدودیتهای نوع برابری، مشکل یافتن پایینترین نقطه نمودار یک تابع f 0 بر روی منیفولد است (شکل 3.1 را ببینید).

نقاطی که تمام محدودیت ها را برآورده می کنند (یعنی نقاط مجموعه ) معمولاً مجاز نامیده می شوند. یک نقطه مجاز x* حداقل شرطی تابع f 0 تحت قیدهای f i (x) = 0، i = 1، ...، k (یا راه حلی برای مسئله (3.1)–(3.2) نامیده می شود، اگر برای تمام نقاط قابل قبول x f 0 (x *) f 0 (x). (3.3)

اگر (3.3) فقط برای x قابل قبول واقع در محله ای V x * نقطه x* ارضا شود، آنگاه از یک حداقل شرطی محلی صحبت می کنیم. مفاهیم حداقل های محلی و جهانی دقیق مشروط به روشی طبیعی تعریف می شوند.

در این نسخه از روش گرادیان، دنباله کمینه سازی (X k) نیز طبق قانون (2.22) ساخته شده است. با این حال، اندازه گام a k در نتیجه حل مسئله کمینه سازی یک بعدی کمکی یافت می شود.

min(j k (a) | a>0)، (2.27)

جایی که j k (a)=f(X k - a· (X k)). بنابراین، در هر تکرار در جهت ضد گرادیان ![]() یک فرود جامع انجام می شود. برای حل مشکل (2.27)، می توانید از یکی از روش های جستجوی تک بعدی که در بخش 1 توضیح داده شده است، استفاده کنید، به عنوان مثال، روش جستجوی بیتی یا روش مقطع طلایی.

یک فرود جامع انجام می شود. برای حل مشکل (2.27)، می توانید از یکی از روش های جستجوی تک بعدی که در بخش 1 توضیح داده شده است، استفاده کنید، به عنوان مثال، روش جستجوی بیتی یا روش مقطع طلایی.

اجازه دهید الگوریتم شیب دارترین روش فرود را شرح دهیم.

مرحله 0.پارامتر دقت e>0 را تنظیم کنید، X 0 ОE n را انتخاب کنید، k=0 را تنظیم کنید.

مرحله 1.(X k) را پیدا کرده و شرط دستیابی به دقت مشخص شده || را بررسی کنید (x k) ||£ e. اگر راضی بود، به مرحله 3 بروید، در غیر این صورت - به مرحله 2.

مرحله 2.حل مسئله (2.27)، یعنی. یک k پیدا کنید. نقطه بعدی را پیدا کنید، k=k+1 را قرار دهید و به مرحله 1 بروید.

مرحله 3محاسبات را با قرار دادن X * = X k، f * = f(X k) کامل کنید.

به حداقل رساندن عملکرد

f(x)=x 1 2 +4x 2 2 -6x 1 -8x 2 +13; (2.28)

بیایید ابتدا مشکل را حل کنیم کلاسیکروش اجازه دهید سیستمی از معادلات را بنویسیم شرایط لازمافراط بی قید و شرط

پس از حل آن، یک نقطه ثابت X*=(3;1) به دست می آوریم. بعد، بیایید اجرا را بررسی کنیم شرایط کافی، که برای آن ماتریس مشتقات دوم را پیدا می کنیم

از آنجایی که طبق معیار سیلوستر، این ماتریس برای "معین مثبت است، پس نقطه X* حداقل نقطه تابع f(X) است. حداقل مقدار f *=f(X*)=0. این راه حل دقیق مشکل است (11).

بیایید یک تکرار از روش را انجام دهیم شیب نزولبرای (2.28). بیایید نقطه شروع X 0 =(1;0) را انتخاب کنیم، مرحله اولیه a=1 و پارامتر l=0.5 را تنظیم کنیم. بیایید f(X 0)=8 را محاسبه کنیم.

بیایید گرادیان تابع f(X) را در نقطه X 0 پیدا کنیم

(X 0) = = (2.29)

بیایید یک نقطه جدید X=X 0 -a· (X 0) با محاسبه مختصات آن تعریف کنیم.

x 1 =

x 2 =  (2.30)

(2.30)

بیایید f(X)= f(X 0 -a· (X 0))=200 را محاسبه کنیم. از آنجایی که f(X)>f(X 0)، گام را با فرض a=a·l=1·0.5=0.5 تقسیم می کنیم. ما دوباره با استفاده از فرمول (2.30) x 1 =1+4a=3 محاسبه می کنیم. x 2 =8a=4 و مقدار f(X)=39 را پیدا کنید. از آنجایی که دوباره f(X)>f(X 0) اندازه گام را بیشتر کاهش می دهیم و a=a·l=0.5·0.5=0.25 را تنظیم می کنیم. یک نقطه جدید را با مختصات x 1 =1+4·0.25=2 محاسبه می کنیم. x 2 =8·0.25=2 و مقدار تابع در این نقطه f(X)=5. از آنجایی که شرط کاهش f(X) بیایید با استفاده از روش یک تکرار انجام دهیم تندترین فرودبرای (2.28) با همان نقطه اولیه X 0 =(1;0). با استفاده از گرادیان از قبل یافت شده (2.29)، پیدا می کنیم X= X 0 -a· (X 0) و تابع j 0 (a)=f(X 0 -a· (X 0))=(4a-2) 2 +4(8a-1) 2 را بسازید. با به حداقل رساندن آن با استفاده از شرط لازم j 0 ¢(a)=8·(4a - 2)+64·(8a - 1)=0 مقدار بهینه اندازه گام a 0 =5/34 را پیدا می کنیم. تعیین نقطه توالی کمینه سازی X 1 = X 0 -a 0 · (X 0) گرادیان تابع متمایز f(x) در نقطه Xتماس گرفت n-بردار بعدی f(x)

، که اجزای آن مشتقات جزئی تابع هستند f(x)در نقطه محاسبه می شود X، یعنی f" (x ) = (df(x)/dh 1 , …, df(x)/dx n) T . این بردار عمود بر صفحه عبور از نقطه است Xو مماس بر سطح تراز تابع f(x)عبور از یک نقطه X.در هر نقطه از چنین سطحی تابع f(x)همان مقدار را می گیرد. با معادل کردن تابع با مقادیر ثابت مختلف C 0 , C 1 , ... ، یک سری سطوح را به دست می آوریم که توپولوژی آن را مشخص می کند (شکل 2.8). بردار گرادیان در جهت سریعترین افزایش تابع در یک نقطه معین هدایت می شود. بردار مخالف گرادیان (-f'(x))

، تماس گرفت ضد گرادیانو به سمت سریعترین کاهش تابع هدایت می شود. در حداقل نقطه، گرادیان تابع صفر است. روشهای مرتبه اول که روشهای گرادیان و کمینهسازی نیز نامیده میشوند، بر اساس ویژگیهای گرادیان هستند. استفاده از این روش ها در حالت کلی به شما امکان می دهد حداقل نقطه محلی یک تابع را تعیین کنید. بدیهی است که اگر اطلاعات اضافی وجود نداشته باشد، از نقطه شروع Xعاقلانه است که برویم سر اصل مطلب X، دروغ گفتن در جهت ضد گرادیان - سریعترین کاهش عملکرد. انتخاب به عنوان جهت نزول[rک ] ضد گرادیان - f'(x )

[k] X[rدر نقطه ]، یک فرآیند تکراری از فرم به دست می آوریم X[ 1] = k+[r]-a k f"(x f'(x )

,

و ک > 0; r=0, 1, 2, ... به صورت مختصات، این فرآیند به صورت زیر نوشته می شود: x i [ r+1]=x i[r] - یک کf(x f'(x )

/x i i = 1، ...، n; r= 0, 1, 2,... به عنوان معیار توقف فرآیند تکراری، یا تحقق شرط افزایش اندک استدلال || k+[r+l] - x[r] || <= e

,

либо выполнение условия малости градиента || f'(x[r+l] )

|| <= g

, در اینجا e و g مقادیر کمی داده شده است. یک معیار ترکیبی نیز امکان پذیر است که شامل تحقق همزمان شرایط مشخص شده است. روش های گرادیان در نحوه انتخاب اندازه گام با یکدیگر متفاوت هستند و ک. در روش با گام ثابت، مقدار گام ثابت معینی برای همه تکرارها انتخاب می شود. یک قدم بسیار کوچک و کاز کاهش تابع، یعنی نابرابری اطمینان حاصل می کند f(x[ r+1])

= f(x[k] – a k f'(x f'(x ))

< f(x f'(x )

. با این حال، این ممکن است منجر به نیاز به انجام تعداد غیرقابل قبولی از تکرار برای رسیدن به حداقل نقطه شود. از طرف دیگر، یک پله خیلی بزرگ می تواند باعث افزایش غیرمنتظره عملکرد شود یا منجر به نوسانات حول نقطه حداقل شود (دوچرخه). به دلیل دشواری به دست آوردن اطلاعات لازم برای انتخاب اندازه گام، روش هایی با گام های ثابت به ندرت در عمل مورد استفاده قرار می گیرند. گرادیان ها از نظر تعداد تکرار و قابلیت اطمینان اقتصادی تر هستند روش های گام متغیر،زمانی که بسته به نتایج محاسبات، اندازه گام به نوعی تغییر می کند. اجازه دهید انواع روش های مورد استفاده در عمل را در نظر بگیریم. هنگام استفاده از شیب دارترین روش فرود در هر تکرار، اندازه گام و کاز حداقل شرایط تابع انتخاب می شود f(x)در جهت نزول، یعنی. این شرایط به این معنی است که حرکت در امتداد ضد گرادیان تا زمانی که مقدار تابع اتفاق می افتد رخ می دهد f(x)کاهش می یابد. از نقطه نظر ریاضی، در هر تکرار لازم است مشکل کمینه سازی یک بعدی با توجه به الفتوابع الگوریتم روش شیب دارترین فرود به شرح زیر است. 1. مختصات نقطه شروع را تنظیم کنید X.

2. در نقطه X[r],

k = 0، 1، 2، ... مقدار گرادیان را محاسبه می کند f'(x[r])

. 3. اندازه گام تعیین می شود الف k، با کمینه سازی یک بعدی بیش از الفتوابع j (الف) = f(x[r]-af"(x[r])).

4. مختصات نقطه مشخص می شود X[X[ 1]: x i [ X[ 1]= x i[r]- a k f' i (x[r])، i = 1،...، ص. 5. شرایط توقف فرآیند استریشن بررسی می شود. اگر آنها برآورده شوند، محاسبات متوقف می شود. در غیر این صورت به مرحله 1 بروید. در روش مورد بررسی جهت حرکت از نقطه X[r] خط سطح را در نقطه لمس می کند k+[X[ 1] (شکل 2.9). مسیر فرود زیگزاگی است، با پیوندهای زیگزاگ مجاور متعامد به یکدیگر. در واقع یک قدم الف k با کمینه سازی توسط انتخاب می شود الفتوابع (الف) = f(x f'(x -af"(x[r]))

. شرط لازم برای حداقل یک تابع j (a)/da = 0.پس از محاسبه مشتق یک تابع مختلط، شرط متعامد بودن بردارهای جهت نزول در نقاط همسایه را به دست می آوریم: دی جی (a)/da = -f’(x[X[ 1]f'(x[r])

= 0.

تفسیر هندسی روش شیب دارترین فرود روشهای گرادیان در سرعت بالا (سرعت پیشرفت هندسی) برای توابع محدب صاف به حداقل میرسند. چنین توابعی بیشترین میزان را دارندم و حداقلمتر مقادیر ویژه ماتریس مشتقات دوم (ماتریس هسی) تفاوت کمی با یکدیگر دارند، یعنی ماتریس N(x) خوب شرطی شده به یاد بیاورید که مقادیر ویژه l i،

=1, …, nمن ، ماتریس ها ریشه های معادله مشخصه هستند با این حال، در عمل، به عنوان یک قاعده، توابعی که به حداقل می رسند، دارای ماتریس های نامشخص مشتقات دوم هستند.<<

(t/m 1). مقادیر چنین توابعی در امتداد برخی جهات بسیار سریعتر (گاهی با چندین مرتبه بزرگی) نسبت به سایر جهات تغییر می کند. سطوح تراز آنها در ساده ترین حالت به شدت دراز است (شکل 2.10) و در موارد پیچیده تر خم می شوند و مانند دره ها به نظر می رسند. توابع با چنین ویژگی هایی نامیده می شوندخندق برنج. 2.10. عملکرد آبکند Xنرخ همگرایی روش های گرادیان نیز به میزان قابل توجهی به دقت محاسبات گرادیان بستگی دارد. از دست دادن دقت، که معمولاً در مجاورت حداقل نقاط یا در موقعیت خندق رخ می دهد، به طور کلی می تواند همگرایی روند نزول گرادیان را مختل کند. با توجه به دلایل فوق، روش های گرادیان اغلب در ترکیب با سایر روش های موثرتر در مرحله اولیه حل یک مسئله استفاده می شود. در این مورد، نکته از حداقل نقطه دور است و گامهایی در جهت ضد گرادیان، کاهش قابل توجهی در عملکرد را ممکن میسازد. روشهای گرادیان مورد بحث در بالا، حداقل نقطه یک تابع را در حالت کلی تنها در تعداد بینهایت تکرار پیدا میکنند. روش گرادیان مزدوج جهت های جستجو را تولید می کند که با هندسه تابعی که به حداقل می رسد سازگارتر است. این به طور قابل توجهی سرعت همگرایی آنها را افزایش می دهد و به عنوان مثال اجازه می دهد تا تابع درجه دوم را به حداقل برساند. f(x) = (x، Hx) + (b، x) + aبا یک ماتریس قطعی مثبت متقارن نبرابر با تعداد متغیرهای تابع هر تابع صاف در مجاورت نقطه حداقل را می توان به خوبی با یک تابع درجه دوم تقریب زد، بنابراین از روش های گرادیان مزدوج برای به حداقل رساندن توابع غیر درجه دوم با موفقیت استفاده می شود. در این صورت، آنها از متناهی بودن باز می مانند و تکراری می شوند. nطبق تعریف، دو X-بردار بعدی ودر تماس گرفتمزدوج نسبت به ماتریساچ نسبت به ماتریس(یا - مزدوج)، اگر محصول اسکالر باشد, (xخوب) = 0. اینجان - ماتریس قطعی مثبت متقارن اندازه n X ص یکی از مهمترین مشکلات در روشهای گرادیان مزدوج، مشکل ساخت مؤثر جهتها است. روش فلچر-ریوز این مشکل را با تبدیل آنتی گرادیان در هر مرحله حل می کند[r])

-f(x در جهت[r],

نسبت به ماتریسص انتخاب به عنوان جهت نزول, انتخاب به عنوان جهت نزول, ..., انتخاب به عنوان جهت نزول[rبا جهتهایی که قبلاً پیدا شدهاند ترکیب شوند -1].. اجازه دهید ابتدا این روش را در رابطه با مشکل کمینه سازی در نظر بگیریم انتخاب به عنوان جهت نزول[rتابع درجه دوم مسیرها r] = -f'(x[r])

] با استفاده از فرمول های زیر محاسبه می شود: در جهت[r p[ r>= 1; +b k-1 -l]،’- مزدوج)، اگر محصول اسکالر باشد)

. p = - r f در جهت[r], انتخاب به عنوان جهت نزول[rمقادیر b نسبت به ماتریس-1 طوری انتخاب می شوند که جهت ها :

(در جهت[r], -1] بودند[- مزدوج 1])= 0.

HP k- در نتیجه برای تابع درجه دوم r+l] فرآیند کمینه سازی تکراری شکل دارد[r]x[[r], =x انتخاب به عنوان جهت نزول[r] -

+a k p - مزدوجکجا جهت فرود بهمتر قدم؛ و ک -اندازه گام الفمورد دوم از حداقل شرایط تابع انتخاب می شود f(x[ r] + f(x)[r])

= f(x[r] + توسط [r])

. در جهت حرکت، یعنی در نتیجه حل مسئله کمینه سازی یک بعدی: a k r ar Xبرای تابع درجه دوم در جهت = -f'(x)

. الگوریتم روش گرادیان مزدوج فلچر-ریوز به شرح زیر است. - مزدوج 1. در نقطه الفمحاسبه شده است .

2. روشن X[X[ 1]. گام m با استفاده از فرمول های بالا مرحله مشخص می شود f(x[r+1])

ک f'(x[r+1])

. و دوره f'(x)

3. مقادیر محاسبه می شود X[rو 4. اگر= 0، سپس اشاره کنید در جهت[r+1] حداقل نقطه تابع است f(x). ماتریس قطعی مثبت متقارن اندازهدر غیر این صورت مسیر جدیدی مشخص می شود +l] از رابطهو انتقال به تکرار بعدی انجام می شود. این روش حداقل یک تابع درجه دوم را در بیش از آن پیدا می کند Xمراحل X[ماتریس قطعی مثبت متقارن اندازههنگام کمینه کردن توابع غیر درجه دوم، روش فلچر-ریوز از متناهی تکرار می شود. در این صورت پس از در نتیجه برای تابع درجه دوم r+l] (p+[r]x[[r],

مسیرها r] 1) تکرار روش 1-4 به صورت چرخه ای با جایگزینی تکرار می شود[r])+

در - مزدوج 1 در جهت[r p[ r>= 1; +1]، و محاسبات به پایان می رسد، جایی که یک عدد داده شده است. در این مورد، از اصلاح روش زیر استفاده می شود: k+); f(x[ r] + = x[r])

= f(x[r] = -f'(x[r];

ب p = -f'( a k p p = -f'(+ap اینجامن ماتریس قطعی مثبت متقارن اندازه- بسیاری از شاخص ها: = (0، n، 2 p، حقوق، ...) X، یعنی روش هر بار به روز می شود انتخاب به عنوان جهت نزول = مراحلمعنی هندسی Xروش گرادیان مزدوج به شرح زیر است (شکل 2.11). از نقطه شروع معین فرود در جهت انجام می شود-f"(x Xحداقل نقطه تابع در جهت است انتخاب به عنوان جهت نزول,

که ] ضد گرادیان -)

متعامد به برداری انتخاب به عنوان جهت نزول. سپس بردار پیدا می شود انتخاب به عنوان جهت نزول , نسبت به ماتریس- مزدوج به انتخاب به عنوان جهت نزول. بعد، حداقل تابع را در جهت پیدا می کنیم انتخاب به عنوان جهت نزولو غیره روشهای جهت مزدوج یکی از مؤثرترین روشها برای حل مسائل کمینهسازی هستند. با این حال، باید توجه داشت که آنها به خطاهایی که در طول فرآیند شمارش رخ می دهد حساس هستند. با تعداد زیادی از متغیرها، خطا می تواند به قدری افزایش یابد که فرآیند حتی برای یک تابع درجه دوم نیز باید تکرار شود، یعنی فرآیند آن همیشه با آن مطابقت ندارد. ماتریس قطعی مثبت متقارن اندازه- بسیاری از شاخص ها: روش شیب دارترین نزول (در ادبیات انگلیسی "روش شیب دارترین نزول") یک روش عددی تکراری ( مرتبه اول) برای حل مسائل بهینه سازی است که به شما امکان می دهد حداکثر (حداقل یا حداکثر) تابع هدف را تعیین کنید: مطابق با روش مورد بررسی، حداکثر (حداکثر یا حداقل) تابع هدف در جهت سریعترین افزایش (کاهش) تابع تعیین می شود. در جهت گرادیان (ضد گرادیان) تابع. تابع گرادیان در یک نقطه که در آن i، j،…، n بردارهای واحد موازی با محورهای مختصات هستند. گرادیان در نقطه پایه شیب دارترین روش فرود است توسعه بیشترروش نزول گرادیان به طور کلی، فرآیند یافتن حداکثر یک تابع یک رویه تکراری است که به صورت زیر نوشته می شود: که در آن علامت "+" برای یافتن حداکثر یک تابع و علامت "-" برای یافتن حداقل یک تابع استفاده می شود. بردار جهت واحد که با فرمول تعیین می شود: ثابتی که اندازه گام را تعیین می کند و برای تمام جهات i-ام یکسان است. اندازه گام از شرط حداقل تابع هدف f(x) در جهت حرکت انتخاب می شود، یعنی در نتیجه حل مسئله بهینه سازی یک بعدی در جهت گرادیان یا ضد گرادیان: به عبارت دیگر، اندازه گام با حل این معادله تعیین می شود: بنابراین، مرحله محاسبه به گونهای انتخاب میشود که حرکت تا زمانی انجام شود که عملکرد بهبود یابد، بنابراین در نقطهای به حداکثر میرسد. در این مرحله، جهت جستجو مجدداً تعیین می شود (با استفاده از گرادیان) و یک نقطه بهینه جدید از تابع هدف و غیره جستجو می شود. بنابراین در این روش جستجو در مراحل بزرگتر انجام می شود و گرادیان تابع در تعداد نقاط کمتری محاسبه می شود. در مورد تابعی از دو متغیر این روشتفسیر هندسی زیر را دارد: جهت حرکت از یک نقطه، خط تراز را در نقطه لمس می کند. مسیر فرود زیگزاگی است، با پیوندهای زیگزاگ مجاور متعامد به یکدیگر. شرط متعامد بودن بردارهای جهت نزول در نقاط همسایه با عبارت زیر نوشته می شود: مسیر حرکت به سمت نقطه منتهی با استفاده از روش شیب دارترین فرود، نشان داده شده در نمودار خط مساوی از تابع f(x) جستجو برای یک راه حل بهینه زمانی به پایان می رسد که در مرحله محاسبه تکراری (چند معیار): مسیر جستجو در یک محله کوچک از نقطه جستجوی فعلی باقی می ماند: افزایش تابع هدف تغییر نمی کند: گرادیان تابع هدف در نقطه حداقل محلی صفر می شود: لازم به ذکر است که روش شیب نزولی هنگام حرکت در امتداد یک دره بسیار کند می شود و با افزایش تعداد متغیرها در تابع هدف، این رفتار روش معمولی می شود. دره یک فرورفتگی است که خطوط تراز آن تقریباً به شکل بیضی با نیم محورهای چند برابر متفاوت است. در حضور دره، مسیر فرود به شکل یک خط زیگزاگ با یک پله کوچک به خود می گیرد که در نتیجه سرعت فرود حاصله به حداقل ممکن کاهش می یابد. این با این واقعیت توضیح داده می شود که جهت ضد گرادیان این توابع به طور قابل توجهی از جهت به نقطه حداقل منحرف می شود که منجر به تاخیر اضافی در محاسبه می شود. در نتیجه، الگوریتم کارایی محاسباتی را از دست می دهد. عملکرد آبکند روش گرادیان همراه با اصلاحات بسیار گسترده است و روش موثرجستجو برای بهینه اشیاء مورد مطالعه نقطه ضعف جستجوی گرادیان (و همچنین روش های مورد بحث در بالا) این است که در هنگام استفاده از آن، تنها اکستریم محلی تابع را می توان تشخیص داد. برای یافتن دیگران افراط های محلیجستجو از نقاط شروع دیگر ضروری است. همچنین سرعت همگرایی روش های گرادیانهمچنین به میزان قابل توجهی به دقت محاسبات گرادیان بستگی دارد. از دست دادن دقت، که معمولاً در مجاورت حداقل نقاط یا در موقعیت خندق رخ می دهد، به طور کلی می تواند همگرایی روند نزول گرادیان را مختل کند. روش محاسبه مرحله 1:تعریف عبارات تحلیلی (به صورت نمادین) برای محاسبه گرادیان یک تابع مرحله 2: تقریب اولیه را تنظیم کنید مرحله 3:نیاز به راه اندازی مجدد روش الگوریتمی برای تنظیم مجدد آخرین جهت جستجو مشخص می شود. در نتیجه شروع مجدد، جستجو دوباره در جهت سریعترین فرود انجام می شود.

.

.

f(x[r]–a k f’(x[r]))

= f(x f'(x - af" (x[r]))

.

j (الف) = f(x[r]-af"(x[r]))

.

![]() ,

,![]()

.

.

![]() مقادیر آرگومان تابع (پارامترهای کنترل شده) در دامنه واقعی هستند.

مقادیر آرگومان تابع (پارامترهای کنترل شده) در دامنه واقعی هستند.![]() برداری است که پیش بینی های آن بر روی محورهای مختصات مشتقات جزئی تابع نسبت به مختصات است:

برداری است که پیش بینی های آن بر روی محورهای مختصات مشتقات جزئی تابع نسبت به مختصات است:![]() کاملاً متعامد به سطح است و جهت آن جهت سریعترین افزایش تابع را نشان می دهد و جهت مخالف (ضد گرادیان) به ترتیب جهت سریعترین کاهش تابع را نشان می دهد.

کاملاً متعامد به سطح است و جهت آن جهت سریعترین افزایش تابع را نشان می دهد و جهت مخالف (ضد گرادیان) به ترتیب جهت سریعترین کاهش تابع را نشان می دهد.

![]() - ماژول گرادیان میزان افزایش یا کاهش تابع را در جهت گرادیان یا ضد گرادیان تعیین می کند:

- ماژول گرادیان میزان افزایش یا کاهش تابع را در جهت گرادیان یا ضد گرادیان تعیین می کند:

![]()

![]()

![]()